Вчера компания Google не только провела первый этап мероприятия Google I/O 2016, но и рассказала кое-что интересное вне конференции.

Оказывается, ещё несколько лет назад Google без какой-либо огласки начала работу над собственным специализированным аппаратным обеспечением для систем машинного обучения. В результате у Google получился Tensor Processing Unit (TPU).

Это ASIC, созданная лишь для участия в процессе машинного обучения. Причём TPU используются компанией в центрах обработки данных уже более года, но лишь сейчас Google решила рассказать об устройстве. За это время Google имела возможность убедиться, что её разработка примерно на порядок превосходит классические решения по параметру производительности на ватт.

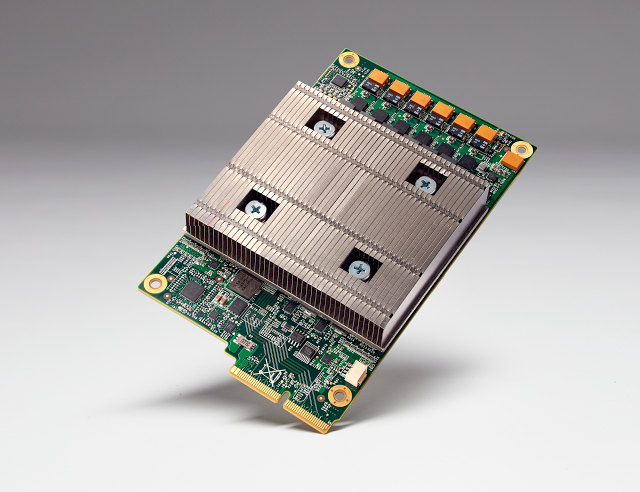

К сожалению, каких-либо технических особенностей Google пока не раскрывает. Сказано лишь, что из-за направления деятельности TPU, которое более терпимо к снижению точности вычислений, требование к количеству транзисторов на одну операцию меньше. Благодаря этому, устройство позволяет обрабатывать большое количество операций в секунду при небольшом транзисторном бюджете. Как можно видеть на фото, устройство обходится компактным радиатором.