Как легко и быстро установить нейронную сеть на домашний ПК

Продолжаем знакомиться с технологиями ближайшего будущего. Ранее мне уже доводилось рассказывать о способе установки нейронной сети на личный ПК для генерации картинок по любому текстовому запросу. Однако, даже несмотря на весьма подробную инструкцию, у многих пользователей она вызывала затруднения. Всем хотелось простого решения, где всего за два клика можно было бы выполнить установку всего и вся и сразу приступить к генерации желаемых изображений. Ну что же, фанфары, гром и молния! Ваше желание исполнено.

Stable Diffusion UI — это простая и удобная оболочка с открытым исходным кодом для нейронной сети Stable Diffusion. Программа всего за два клика бесплатно выполнит установку всех необходимых зависимостей, требуемых для запуска и работы нейронной сети, а также благодаря понятному веб-интерфейсу позволит даже самым зелёным пользователям создавать настоящие шедевры.

Минимальный системные требования:

ОС: Windows 10/11/Linux 64 Бит.

RAM: 8+ Гб.

CPU: 2/4+ ядра 3.0+ ГГц.

GPU: Nvidia с поддержкой CUDA (Возможна работа силами CPU).

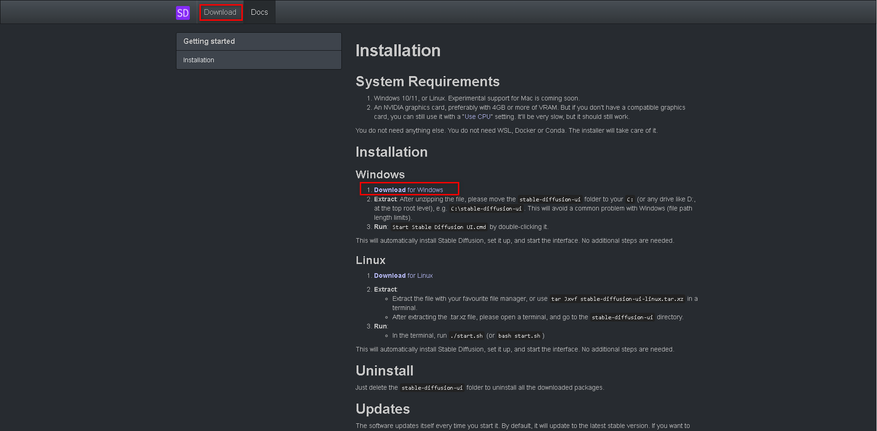

Установка нейронной сети

В установке нет ничего сложного, благо всё довольно просто.

1. Скачиваем установщик с нейронной сетью.

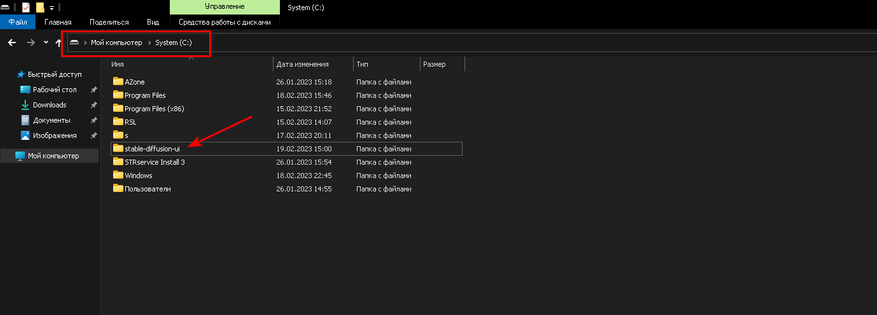

2. Выполняем распаковку файлов в корень любого диска (Это важно!).

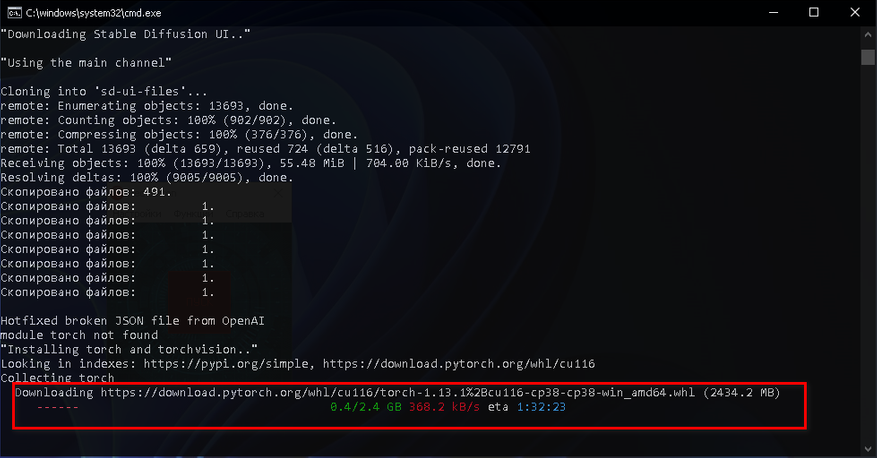

3. После распаковки запускаем в папке C:\stable-diffusion-ui файл Start Stable Diffusion UI. cmd и дожидаемся окончания загрузки и установки всех необходимых зависимостей.

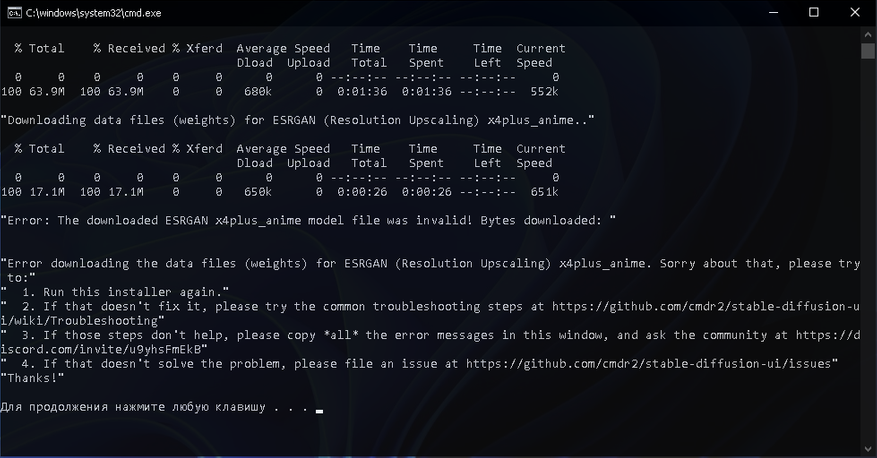

Если входе загрузки появится подобная ошибка, то выполните перезапуск программы.

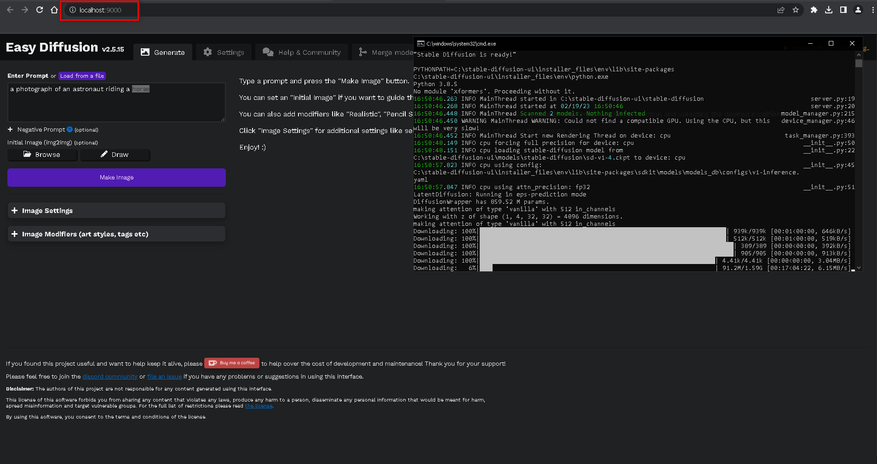

4. Ближе к завершению установки вас автоматически перенесёт в браузере по адресу localhost:9000. И можно гордо заявить, что дело сделано. Однако не спешите вводить запрос и нажимать Make Image, так как перед нами пока всего лишь тело без мозгов.

Установка модели

Чтобы нейронная сеть понимала, что и как рисовать, ей необходимы обученные мозги. Вручную обучать их слишком долго, и ради экономии времени люди создали веб-ресурсы, где делятся заранее обученными моделями.

Популярные ресурсы:

- https://civitai.com/?types=Checkpoint — множество моделей с удобным поиском и демонстрацией результата.

- https://huggingface.co/models — множество различных моделей.

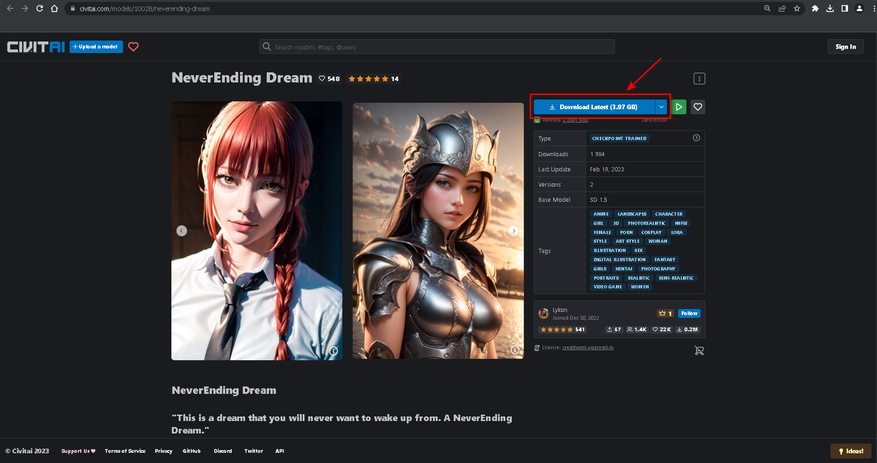

Скачиваем желаемую модель. Я остановил свой выбор на NeverEnding Dream.

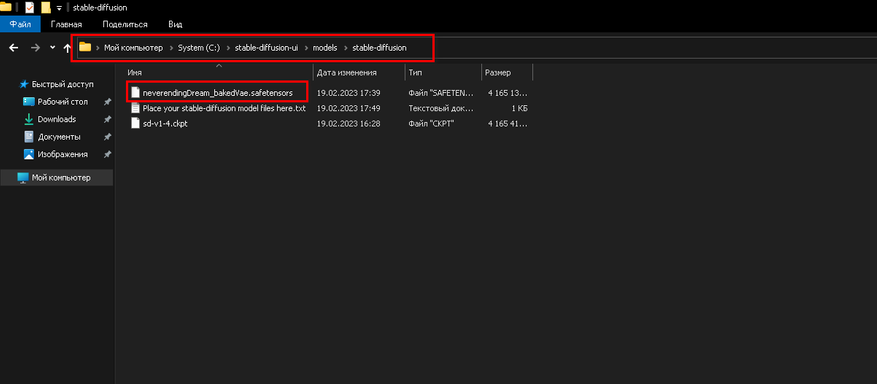

Переносим файл обученной модели в:

C:stable-diffusion-uimodelsstable-diffusion

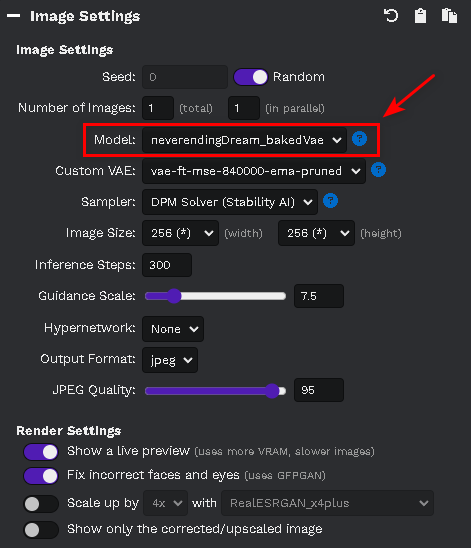

Перезапускаем нейронную сеть через Start Stable Diffusion UI. cmd и в панели управления выбираем скаченную модель.

На этом установка модели официально завершена и можно переходить к генерации желаемой картинки.

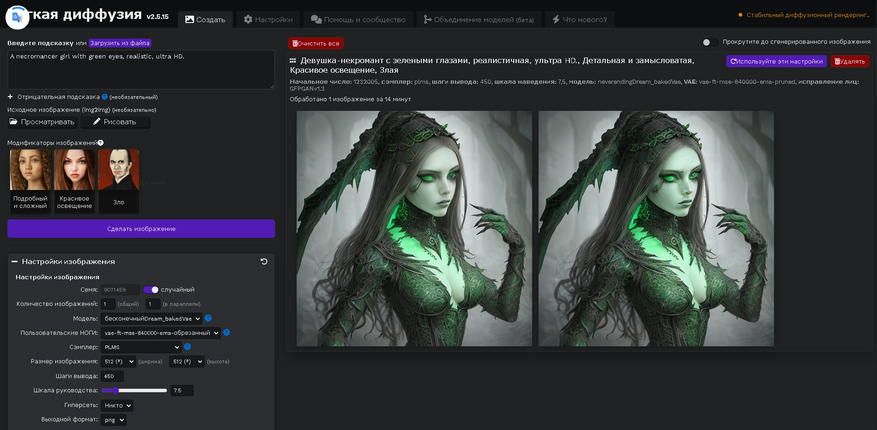

Генерация

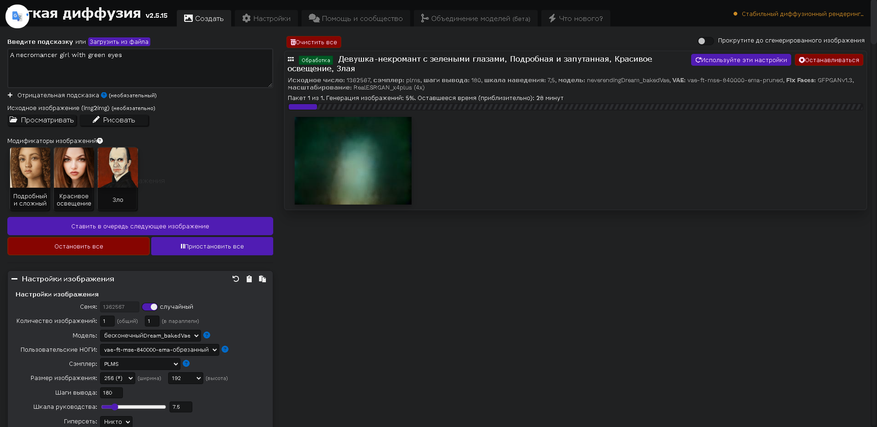

У меня видеокарта AMD и я вынужден всё считать ресурсами CPU. У вас качество и скорость генерации может отличаться.

Мои параметры:

- Запрос: A necromancer girl with green eyes, realistic, ultra HD (Девушка-некромант с зелеными глазами).

- Модель: NeverEnding Dream.

- Количество проходов: 180 (CPU).

- Сэмплер: PLMS.

- Фильтры и стили: подробный, красивое освещение, зло.

- Исправление лица: активно.

- Апскейлинг: активирован.

Нажимаем на Make Image.

Результат

Если прикупить Nvidia и добавить пару сотен проходов, то станет ещё лучше!

Выводы

Со всей ответственностью заявляю, что художникам средний руки — кранты! Новое время наступило, и никто не в силах этому помешать. Познавайте, делитесь своими прекрасными творениями и самое главное — никогда не предавайте себя!

ПС. Инструкция для видеокарт AMD.

156 комментариев

Добавить комментарий

SD ничего этого не делает. Ей вообще пофиг на контекст. Нельзя написать «карлики из Челябинска воруют уголь» и наблюдать, как она сама придумает историю, из которой тебе предоставит стоп-кадры. Ей нужно точно объяснить, как должно выглядеть изображение, и что на нём: «карлик с бородой, одетый в робу, несёт мешок, ночь» и т.д.

https://sun9-21.userapi.com/impg/WOcvrmauQ6m8meP1Rko-OMpdnTVEMkijO32sjw/OwSuLrZ1R3w.jpg?size=1024x2048&quality=96&sign=807606d7a3e2e26b841b0220b04b7842&type=album

Никаких высококачественных фильтров или специальных запросов не применялось, ибо нет времени, а ещё я забыл применить исправление глаз и лица. 80 проходов. Если вам нужно было действие в кадре, то нужно скачать другую модель.

Спасибо за статью!

#Fantasy #Anime и т. п. Стиль зависит от настроек ввода.

Это ошибка или опечатка.

на github белым по черному написано еще и Linux.

Нейронная сеть поможет сохранить урожай

Новосибирские биоинформатики представили на международной конференции «Генетика, геномика, биоинформатика и биотехнология растений» (PlantGen2021) нейросеть, способную на ранней стадии выявлять заболевания зерновых, сохраняя тем самым урожай.

У товарища выше тупо базы нужные для работы в ос не были установлены.

И пары лет не прошло, обленились все, забыли что все программы, драйверы и библиотеки пол века руками ставили.

Я со своей RX 550 так и делаю.

У меня под win7 Python выше 2.8.5 отказывается ставится (что не удивительно учитывая что на сайте разработчика указано что для win7,8 последняя версия это 2.9) ссылаясь на отсуствие библиотеки.

Батник EasyDiffusion при этом сам докачал все кроме питона и все запускается.

Единственно что после выбора люой модели после перезапуска перестает запускаться на 2 раз, если не убрать галку«запомнитьпараметры->модель» в настройках.

UPDATE переустановил питон на 2.8.10 = stable-diffusion-webui-master стал запускаться

Python 2.8.16 это последняя поддерживаемая версия под win7. Выше даже не пытайтесь.

Попросил нарисовать домик на опушке зимой с луной. Результат крайне впечатлил.

Жаль, что моя видеокарта программе не нравится (GTX 1660), приходится ЦП греть.

Ага, понял. Использование памяти поставил на LOW и вроде понеслась.

Ручная установка CUDA не требуется.

Аналогичная проблема. Побороть то получилось, рисует, но почему то не используется дискретная видеокарта (1650Ti). CUDA установил, не помогло. Подскажите пожалуйста, как настроить дискретную видеокарту?

Processor: Intel64 Family 6 Model 165 Stepping 2, GenuineIntel

Compatible Graphics Cards (all): NVIDIA GeForce GTX 1650 Ti (cuda:0) (0.7Gb free / 4.3 Gb total)

Used for rendering ?: NVIDIA GeForce GTX 1650 Ti (cuda:0) (0.7Gb free / 4.3 Gb total)

Но — загрузка 1650 — 0%, проц 27%, видео карта в процессоре 8%.

1. «Со всей ответственностью заявляю, что художникам средний руки — кранты!» — не средней руки, а вообще всем.

благо, 95% всех рисовак пока полируют ладошки исключительно на аниме, но и в других жанрах ИИ значительно преуспевает, в отличии от кожаных мешков

2. Я бы озаглавил статью так «Как легко и быстро установить нейронную сеть, пока верха не смекнули и не ввели налоги/запреты на халяву»

«Спешите купить видеокарту и качать модели нейронки, пока ещё не поздно!».

картинка 1024*1024 бешенно нагружает ГПУ (3070Ti) температура резко взмывает под 80 градусов (температурные и поверлимиты прописанные в MSI AB почему-то игнорируются), ядро на максималки, память под завязку… пришлось выключить не дожидаясь результата.

а вот картинка 512*512 уже полегче, и нагрузка меньше и температуры.

будем ковырять

итоговый вес сетки — 19.6 Гб

Inside, outside, 1girl, (eyeliner:1.1), (pastel_goth:1.1), blue_eyes, long_hair, bangs, straight bangs, fringe, shiny_skin, (huge_thighs:1.1), (wide_hips:1.1), (huge breasts:1.1), (ostrich onesie:1.2), full_body, medium_shot, HD.

Ну и хочу успокоить художников ии их не заменит. Вовсяком случае в ближайшее время. Хоть рисует красиво, но пока сгенерируешь то что тебе надо и потом это тебе ещё надо доработать под заказ затратишь время больше чем рисовать с нуля. Причём хочу заметить все эти красивые примеры девушек и прочих монстров ненужные для бизнеса. На них художники не зарабатывают.

На данный момент ии хорош для генерации идей, но по своему примеру могу сказать тратишь время в разы больше чем делать по старинке.

Error: The model for Stable Diffusion has not been loaded yet! If you've tried to load it, please check the logs above this message for errors (while loading the model).

модели скачивал разные

Error: CUDA error: misaligned address CUDA kernel errors might be asynchronously reported at some other API call,so the stacktrace below might be incorrect. For debugging consider passing CUDA_LAUNCH_BLOCKING=1.

Уже установил с сайта Nvidia само Cuda 12.0.1, всякие pyTorch, anaconda и прочее что только мог найти в инете. Ничего не помогает.

Даже на CPU не хочет ничего генерировать, пытается и потом либо ошибка либо результат что-то размытое и т д

но нейронка на старте под свежие фиксы качала актуальные библиотеки! 2,7гб

надо эпрувить обращение к каталогам.

Дисковое пространство.

128 SSD мало!

Но за новый опыт, большое спасибо.

вопрос есть ли возможность сливать фото, скажем свои с теми что в библиотеке. Или применять фильтры к своим фото.

где в варе (переменное окружение) указать второй путь к каталогу с моделями, возможно ли это?

Ошибки начинаются из-за бага очистки видеопамяти. Поясню, загружено задание, качество определено изменяем на высокое — получаем ошибку, выделить память невозможно. Недостаточно видеопамяти, От предыдущего рендера память не очищена. у меня 1660S если я проверил сборку и версионность у меня на момент старта локалхоста и отработки первого проекта съедено 5790 видеопамяти.

передано разработчикам, да я зануда, работа такая.

Я таких рисую https://ixbt.photo/?id=photo:1572220#

P.S. Кстати, вроде более 50 проходов нет смысла делать. Хотя, возможно, от модели зависит…

Запрос тот, что вы хотите изменить в выделенном участке.

Возможно, но сам модуль автоматом не устанавливается.

О чем выводится сообщение:

No module 'xformers'. Proceeding without it.

xformers

xformers-0.0.16rc425.dist-info

в

диск:\stable-diffusion-ui\installer_files\env\Lib\site-packages\

xformers запускается, но теперь требует плагин triton… через pip install triton (как где то вычитал) не получилось поставить и пока не разбирался что с ним сделать. Генерация работает, быстрее чем раньше.

PS с питоном я тоже пока глубоко не разбирался…

Developer Console.cmd

cd .\installer_files\env\lib\site-packages

pip install xformers

triton, насколько нашел

git clone https://github.com/openai/triton.git

cd triton/python

pip install cmake

pip install -e

И не одна и при перезапуске. ???

Edit: нашёл виновника: Adguard — AntiTracking — DPI protection

Надо сделать так чтобы в скобках было это:

shared.demo.launch(

show_error=True,

enable_queue=False,

server_name='0.0.0.0',

server_port=7860,

debug=cmd_opts.gradio_debug,

auth=(«admin», «admin»),

inbrowser=cmd_opts.autolaunch,

prevent_thread_lock=True

)

port соответственно ваш порт, а admin-admin меняем на логин и пароль.

Так вы сможете запускать stable diffusion не только на локальном компе, но и с любого места в интернете, или через VPN

в запрос пишу <lora: название:1> — никакого эффекта

Пробовал в запросе менять по разному прописывал, тоже не помогает.

Lora взяты с сайта https://civitai.com/ там полно картинок и подробные настройки к ним. я в точности повторил все эти настройки, но пришёл к выводу что Lora не работает. Поясните пожалуйста кто-то — на чём те люди генерили картинки при помощи lora ???

На Stable Diffusion я не нашёл папки lora, а в EasyDiffusion lora не работает вообще + к тому же многие генерации очень сильно отличаются от оригинальных картинок на сайте. Каким путём пойти чтобы достичь такого же качества как и на https://civitai.com/?

Error: Could not load the stable-diffusion model! Reason: 'time_embed.0.weight'

Добавить комментарий