Новый инструмент против искусственного интеллекта «отравляет» генеративные модели, чтобы защитить произведения искусства

Новый инструмент от исследователей из Чикагского университета обещает защитить искусство от того, чтобы модели искусственного интеллекта поглощали его и использовали для обучения без разрешения путем «отравления» данных изображений.

Инструмент, известный как Nightshade, настраивает данные цифровых изображений способами, которые, как утверждается, невидимы для человеческого глаза, но вызывают всевозможные помехи для моделей генеративного обучения, таких как DALL-E, Midjourney и Stable Diffusion.

Этот метод, известный как «отравление данных», утверждает, что он привносит «неожиданное поведение в модели машинного обучения во время самого обучения». Команда Чикагского университета утверждает, что их исследовательская работа показывает, что такие атаки с отравлением могут быть «на удивление» успешными.

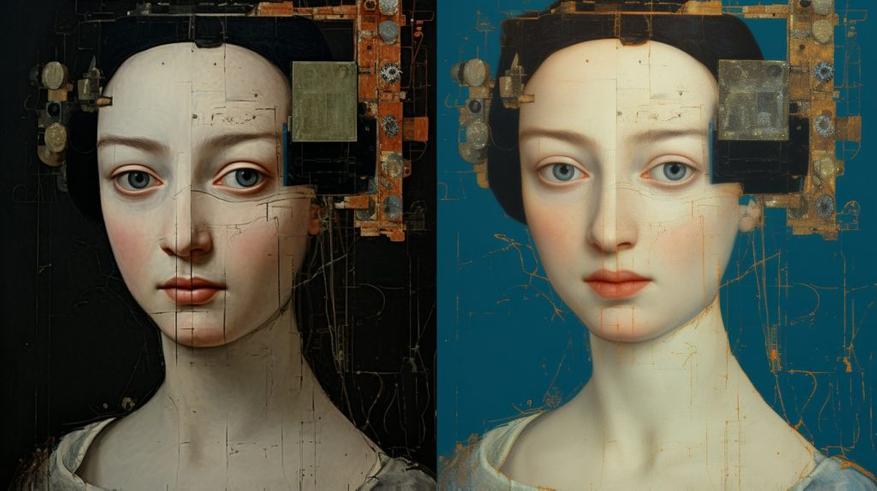

Судя по всему, изображения образцов яда выглядят «визуально идентично» безвредным изображениям. Утверждается, что образцы яда Nightshade «оптимизированы по эффективности» и могут испортить Stable Diffusion SDXL менее чем за 100 образцов яда.

Специфика работы этой технологии не совсем ясна, но она включает в себя изменение пикселей изображения невидимыми для человеческого глаза способами, в то же время заставляя модели машинного обучения неверно интерпретировать контент. Утверждается, что зараженные данные очень сложно удалить, а это означает, что каждое зараженное изображение необходимо вручную идентифицировать и удалить из модели.

Используя Stable Diffusion в качестве подопытного, исследователи обнаружили, что потребовалось всего 300 образцов яда, чтобы заставить модель думать, что собака — это кошка, а шляпа — это торт. Или наоборот?

В любом случае, они также говорят, что влияние отравленных изображений может распространяться на связанные концепции, позволяя умеренному количеству атак Nightshade «дестабилизировать общие функции в генеративной модели преобразования текста в изображение, фактически отключая ее способность генерировать осмысленные изображения».

Несмотря на все вышесказанное, команда признает, что уничтожить более крупные модели не так-то просто. Потребуются тысячи отравленных изображений. Что, вероятно, хорошо с точки зрения злоумышленника. Другими словами, потребуются согласованные усилия, чтобы подорвать любую крупную генеративную модель.

Источник: New anti-AI tool 'poisons' generative models to protect artwork from unauthorized robo-Rembrandts

5 комментариев

Добавить комментарий

При этом, я могу спокойно отличить что было нарисовано нейросетью.

Что инди студии что крупные компании их используют. И как сказал, хоть в как они их не дорисовывают их, все рисунки от нейросети легко отличить. У него свой неповторимый стиль (который мне не нравится почему-то, линии не очень красиво строятся). Но сам факт.

А эта травилка только накакать. Станет как стар форс.

Плюс, никто не мешает тебе сделать скриншот и залить его. А не отравленную картинку.

Это отравление — алгоритм, который можно распознать и обратить. Будем и дальше продолжать генерировать картинки с тяночками)

Добавить комментарий