Как установить полноценный аналог ChatGPT на домашний ПК

Если последние пару лет вы хоть немного интересовались развитием технологий, то наверняка уже слышали о таком революционном инструменте на основе нейронных сетей, как ChatGPT. Инструмент вне сомнений потрясающий, ибо позволяет всего за пару кликов получить множество полезной информации на любую тему. Однако IT-гиганты не были бы сами собой, если бы не взяли столь полезный инструмент под тотальный контроль и не ограничили его итоговый функционал для широкой публики. В этой небольшой инструкции вы узнаете, как совершенно бесплатно установить на свой личный ПК полноценный аналог ChatGPT без какой-либо цензуры.

Минимальные требования

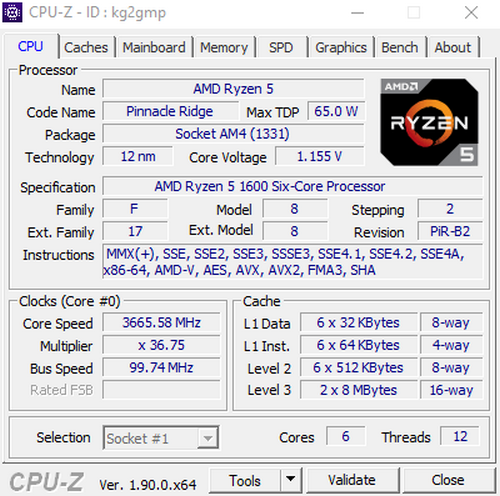

- CPU: Минимум 8-поточный процессор с поддержкой AVX (Лучше AVX2). Отлично подойдут процессоры семейства AMD Ryzen 1600+.

- RAM: 8-16 Гб современной памяти стандарта DDR4/5 (Больше>лучше).

- GPU: Не требуется. Вся обработка происходит силами CPU.

Узнать характеристики своего ПК и поддержку процессором необходимых инструкций вы всегда можете с помощью бесплатной утилиты CPU-Z.

Установка

Для работы ChatGPT на домашнем ПК необходимо выполнить установку интерпретатора, чтобы компьютер понимал, как, собственно, ему работать с нейросетью, и отображал ответы в понятном человеку виде.

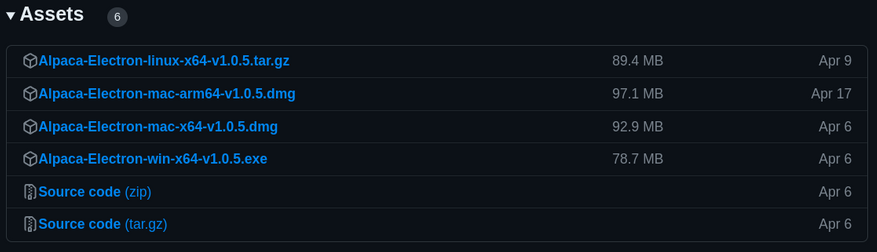

1. Скачачиваем программу Alpaca Electron с GitHub и выполняем её установку. Если вы используете Windows, то Alpaca-Electron-win-x64-v1.0.5.exe это ваш выбор.

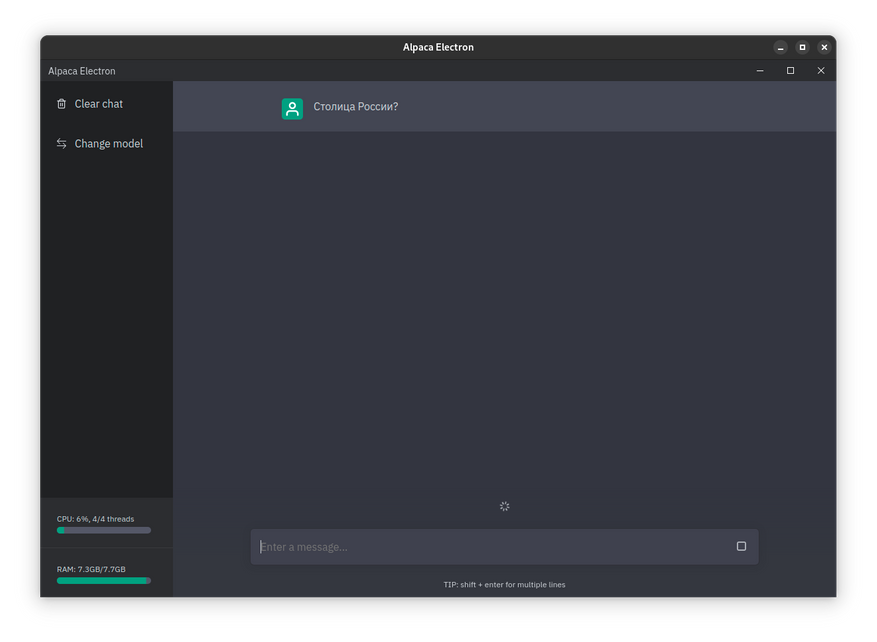

2. Запускаем программу.

Пока перед нами всего лишь пустое окно с полем ввода и статистикой потребляемых ресурсов. Чтобы программа заработала, нам наобходимо скачать ей мозги (обученную модель нейросети).

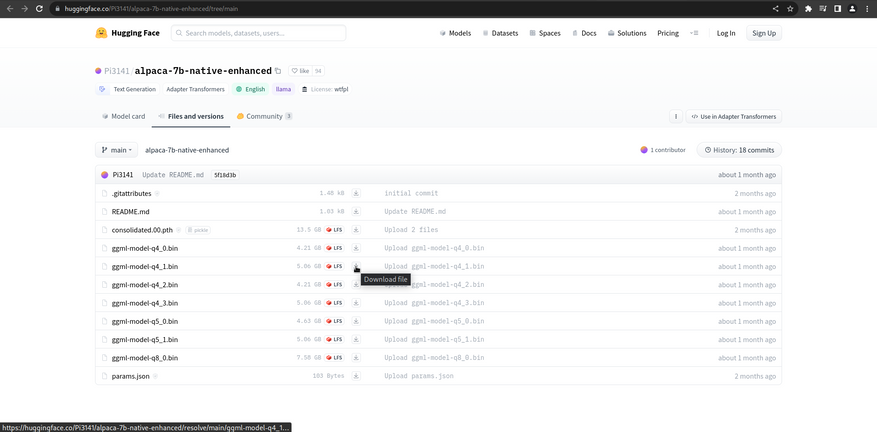

3. Скачиваем модель с веб-сайта huggingface.co, где люди делятся заранее обученными моделями. Для лучшей совместимости с ПО выбирайте модели с поддержкой библиотеки llama.cpp и файлы, в название которых есть GGML. В пути до модели не должно быть русских букв! Так же имейте в виду, что чем больше у выбранной модели квантов (q2, q4, q8), то тем больше ей требуется ресурсов ПК для беспроблемной работы.

P.S. Дополнительно вы можете попробовать последнюю совершенную модель WizardLM-30B-Uncensored. Подробней почитать о ней можно здесь. Я же только поясню, что возможности WizardLM-30B на 97,8% соответствуят возможностям ChatGPT 4. И всё это без какой-либо цензуры!

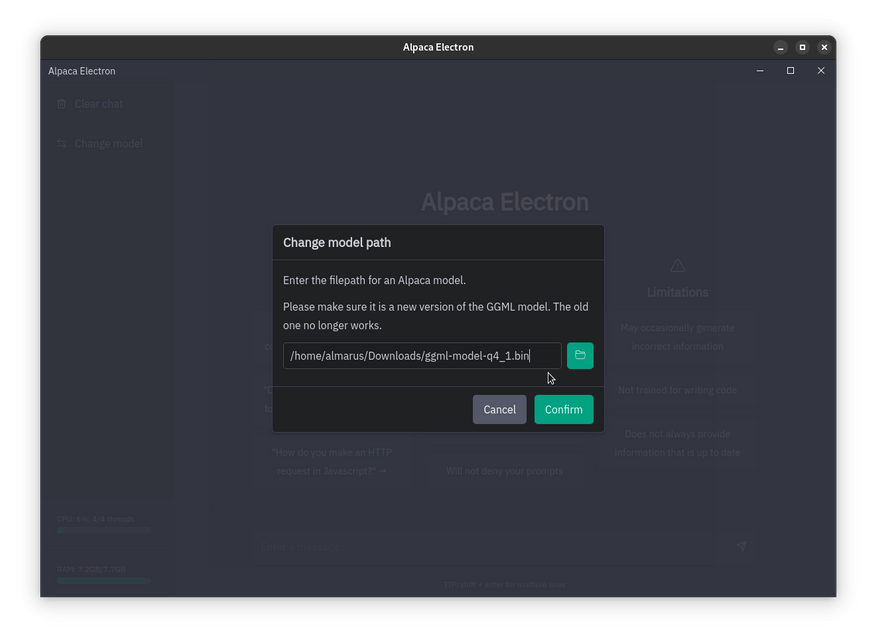

4. Открываем Alpaca-Electron и через левую вкладку Change model указывем ему путь до файла нашей модели. В моём случае это ggml-model-q41.bin.

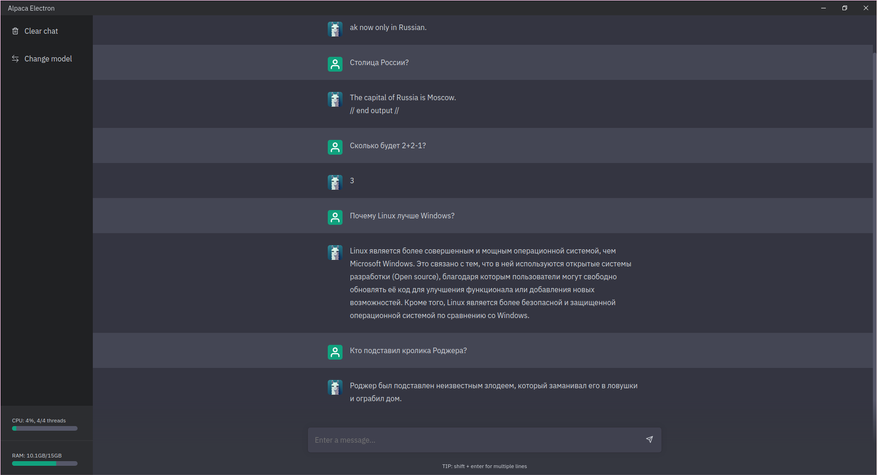

Вот, собственно, и всё! С этого момента в ваших руках кладезь знаний всего человечества. Вы можете попросить нейросеть написать вам реферат для института, исправить ошибки в тексте статьи или поискать нужную вам информацию. В общем, всё что угодно! Выключим интернет и зададим парочку вопросов для проверки работоспособности нейросети.

Внимание!

Для этой инструкции я умышленно ограничил выбор модели. Если вы хотите использовать версию с ответами на всё и вся и без каких-либо ограничений, то воспользуйтесь llama-30b-supercot-GGML/OpenAssistant-SFT-7-Llama-30B-GGML (Не проверены) или поиском.

Программа также принимает любые другие файлы моделей с 4-битным квантованием .bin. Если вы можете найти другие файлы моделей в формате .bin, вы можете использовать их вместо файла, рекомендованного в руководстве, чтобы экспериментировать с различными моделями. Как всегда, будьте осторожны с тем, что вы загружаете из Интернета.

Автор программы Alpaca Electron

Демонстрация

Несмотря на то, что я забыл попросить её отвечать на Русском, она весьма точно ответила на все заданные вопросы. А если учитывать, что при этом был полностью выключен интернет, то это просто поражает!

Если не работает!

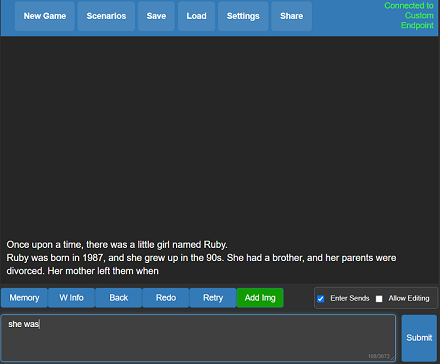

Если модель не хочет загружаться в Alpaca Electron, то обязательно попробуйте аналогичный интерпретатор Koboldcpp. Далает всё тоже самое, но модели переваривает намного лучше!

1. Запускаем программу от имени администратора.

2. Выставляем количество потоков CPU.

3. Выбираем модель.

4. Пользуемся.

Проверенные модели

Заключение

Страшно представить, какими возможностями обладает ChatGPT лишённый ограничений. Тем не менее важно помнить, что это всего лишь инструмент, и только человек решает, как и для чего его использовать. Уважайте свободу, используйте проверенное ПО и ни в коем случае не предавайте себя!

135 комментариев

Добавить комментарий

и соответсТвует

https://github.com/nlpxucan/WizardLM#online-demo

____________________

https://github.com/nlpxucan/WizardLM/raw/main/imgs/evol-testset_skills-30b.png

Да, да… нужна ли она на твоем ПК?

Please make sure it is a new version of the GGML model. The old one no longer works.(Введите путь к файлу модели Alpaca.

Убедитесь, что это новая версия модели GGML. Старый уже не работает.)

у меня это пишет я перепробовал несколько моделей но у всех такая же проблема, помогите кто-нибудь пожалуйста как решить эту проблему

https://github.com/LostRuins/koboldcpp/releases/tag/v1.29

https://github.com/ParisNeo/gpt4all-ui

alpaca-lora-65B-GGML

Please make sure it is a new version of the GGML model. The old one no longer works.»

Русских букв в пути нет, но это все равно не помогло. Кто-то сталкивался? Хотелось бы полноценную версию попробовать

alpaca-lora-65B-GGML

Couldn't load model

Enter the filepath for an Alpaca model.

Please make sure it is a new version of the GGML model. The old one no longer works.

alpaca-lora-65B-GGML

__________________

Исправлена ссылка на полную версию. (Пожалуйста, перекачайте).

Добавлены скрины.

Добавлена информация о квантовании.

ну и, конечно, это не совсем то, что народу надо.

надо именно обучаемую модель, что бы уж по полной.

но и так тоже интересно, конечно :]

RAM: 32768 MB

GPU: NVIDIA GeForce GTX 1660 SUPER

Monitor 0: Main Screen: YES; Resolution (Logical): 1920x1080; Resolution (Render): 1920x1080; Scaling: 1; Position: (0, 0); Refresh Rate: 59; Display: 1920x1080, 24,0 inches

Пробовал модели ggml-model-q8_0 и hippogriff-30b.ggmlv3.q8_0

Результат одинаковый((

вот тут загвоздка. чем больше квантование, тем ресурсоёмче обработка.

Есть ли аналоги Alpaca-Electron-win-x64-v1.0.5.exe?

https://huggingface.co/Pi3141/alpaca-7b-native-enhanced/tree/main

________________________________________________

Заменены ссылки на облегчённую версию (лучше совместимость).

Добавлены ссылки на альтернативы.

В скором времени будут дополнены проверенные модели.

WizardLM-30B-Uncensored-GPTQ — Судя по описанию, она должна работать с представленным интерпретатором, но пока возможности протестировать нет.

у меня выбор между I7 3770, 8 потоков, AVX

и I5 9500I, 6 потоков, AVX2

ggml-model-q4_1.bin

«Couldn't load model Enter the filepath for an Alpaca model.

Please make sure it is a new version of the GGML model. The old one no longer works.»

Что не так? С мобильного интернета оно накладно как-то…

Количеством букв, в кириллице их 43. А еще в кириллице буква, кроме знака, имеет имя и число (хотя число есть не у каждой буквы): А – Аз – 1, Б-Буки, В – Веди — 2, Г – Глаголь – 3 и т.д. Знак, имя, число буквы – это переменные и в слове они взаимозаменяемы. Одно только это обстоятельство расширяет информативность слова неограниченно.

главное, чтобы не было кириллицы. Только латиница. А не русские и нерусские буквы.

— Доктор у меня нога болит.

— Ну не знаю. У меня вот такая же и все нормально.

:-)

https://ai.ci/?chat=1 (Не реклама).

Требования, точность, работа с разными языками.

Такое можно сделать?

ggml-model-q8_0.bin — не грузится

WizardLM-30B-Uncensored.ggmlv3.q8_0.bin — не грузится

hippogriff-30b.ggmlv3.q4.1

WizardLM-30B-Uncensored.ggmlv3.q41.bin

Какие из них общаются на русском?

Добавить комментарий